Adobe Research et UC Berkeley collaborent pour détecter la manipulation des visages dans Adobe Photoshop

Le lancement d’Adobe Photoshop en 1990 a marqué une étape majeure dans la démocratisation de la créativité et de l’expression. Depuis, Photoshop a eu d’importantes répercussions sur la création et, plus généralement, notre culture visuelle.

Bien que nous soyons fiers de l’impact mondial de Photoshop et d’autres de nos outils de création, nous sommes également conscients des enjeux éthiques de notre technologie. Dans un monde où la retouche d’images est devenue omniprésente – le faux contenu est un fléau de plus en plus préoccupant —, la confiance en ce que nous voyons est on ne peut plus primordiale. Adobe a l’intention ferme de développer de nouvelles technologies comme l’intelligence artificielle (IA) de manière utile et responsable, en étudiant continuellement leur utilisation. Et ce afin de renforcer la confiance et l’autorité dans le secteur des médias digitaux.

C’est dans ce contexte que Richard Zhang et Oliver Wang, tous deux chercheurs chez Adobe, et Sheng Yu Wang, Andrew Owens et Alexei A. Efros, leurs collaborateurs d’UC Berkeley, ont développé une méthode pour détecter les retouches d’images effectuées à l’aide de la fonction Modification des traits du visage de Photoshop dans le cadre du programme DARPA MediFor. Bien que cette collaboration entre Adobe Research et UC Berkeley n’en soit encore qu’à ses débuts, elle marque une avancée en matière de démocratisation de la criminalistique des images – la science qui consiste à découvrir et analyser les retouches des images digitales.

Cette nouvelle étude s’inscrit dans un projet plus large déployé par Adobe pour mieux détecter les manipulations d’images, de documents, de vidéos et de contenus audio. Si les précédentes études d’Adobe se concentraient sur la détection des manipulations d’images (fusion, duplication ou suppression), celle-ci porte sur la fonction Modification des traits du visage de Photoshop, notamment utilisée pour changer les expressions du visage. Les effets de cette fonction peuvent être ténus, ce qui en faisait un scénario de test intéressant pour détecter les modifications des visages – radicales ou subtiles.

Cette nouvelle étude s’appuie sur quelques questions élémentaires :

- Est-il possible de créer un outil capable de mieux identifier les visages manipulés qu’un être humain ?

- Cet outil pourrait-il décoder les changements spécifiques apportés à l’image ?

- Pourriez-vous alors annuler ces changements pour revenir à l’original ?

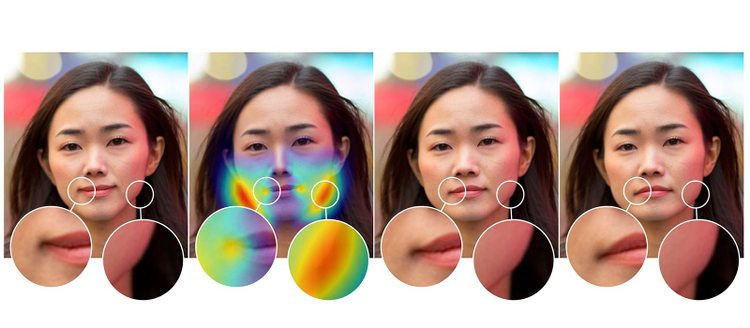

Grâce à la formation d’un réseau neuronal convolutif (CNN, Convolutional Neural Network) – un type d’apprentissage en profondeur –, ce projet de recherche a permis de reconnaître les images modifiées des visages. Les chercheurs ont constitué un vaste ensemble d’images en rédigeant un script qui applique la fonction Modification des traits du visage de Photoshop à des milliers de photos trouvées sur Internet. Un sous-ensemble de ces photos a été aléatoirement choisi pour la formation. Un artiste a également été chargé de retoucher des images, qui ont ensuite été incorporées dans le jeu de données. Cette touche de créativité humaine a élargi l’éventail des modifications et techniques utilisées dans le test au-delà des images synthétiques.

« Pour être utile, cette approche devait permettre d’identifier beaucoup plus efficacement que l’œil humain les visages retouchés », explique Oliver Wang. « Nous avons commencé par montrer des paires d’images (version originale et version retouchée) aux personnes qui savaient que l’un des deux visages avait été modifié. »

Ces yeux humains ont pu reconnaître 53 % des visages modifiés, ce qui est à peine mieux que le hasard. Toutefois, dans une série d’expériences, l’outil de réseau neural a obtenu un score de 99 %.

Cet outil a également identifié certaines zones et méthodes de déformation des visages. Durant l’expérience, l’outil a exécuté un calcul pour rétablir la version originale des images modifiées – même les chercheurs ont été impressionnés par les résultats.

« Cela peut sembler impossible, car il y a une multitude de variables dans la géométrie des visages », indique Alexei A. Efros, UC Berkeley. « Toutefois, dans ce cas, comme le machine learning peut examiner une combinaison de données d’image de bas niveau, telles que les artefacts de déformation, et de repères de haut niveau, tels que la disposition, cela semble fonctionner. »

« Le concept d’un bouton magique universel pour annuler les retouches d’images n’est pas prêt de devenir une réalité », précise Richard Zhang. « Or dans le monde dans lequel nous vivons, il est de plus en plus difficile de se fier aux informations digitales que nous consommons et je suis impatient d’explorer ce domaine de recherche de façon plus approfondie. »

Que nous réserve l’avenir ? La mission d’Adobe est d’être utile au créateur et de respecter le consommateur. Nous mettons à disposition de nos clients des outils qui leur permettent de laisser libre cours à leur imagination et de donner vie à leurs idées. En parallèle, nous travaillons sur de nombreux projets Adobe Research pour vérifier l’authenticité des médias digitaux créés avec nos produits, mais aussi pour identifier et empêcher les usages abusifs.

« Il s’agit d’une étape importante dans la capacité à détecter certains types de retouches d’images et la fonctionnalité d’annulation fonctionne étonnamment bien », conclut Gavin Miller, directeur d’Adobe Research. « Outre ce type de technologie, la meilleure défense sera un public avisé, conscient que le contenu peut être manipulé – souvent pour le divertir, mais parfois aussi pour le tromper. »

Nous continuerons à explorer la question de l’authenticité du contenu avec nos clients, nos partenaires et la communauté. Nous nous félicitons du dialogue en cours sur les protections qui pourraient être mises en place, tout en encourageant la créativité et le storytelling dans un paysage digital en constante évolution.

Le chemin de la démocratisation de la criminalistique des images ne fait que commencer.